記事一覧へ

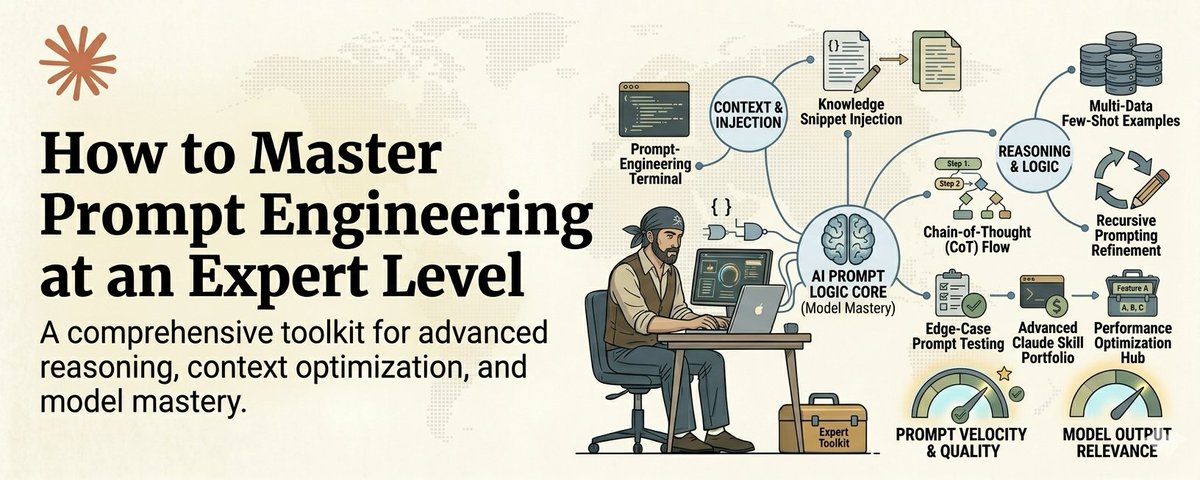

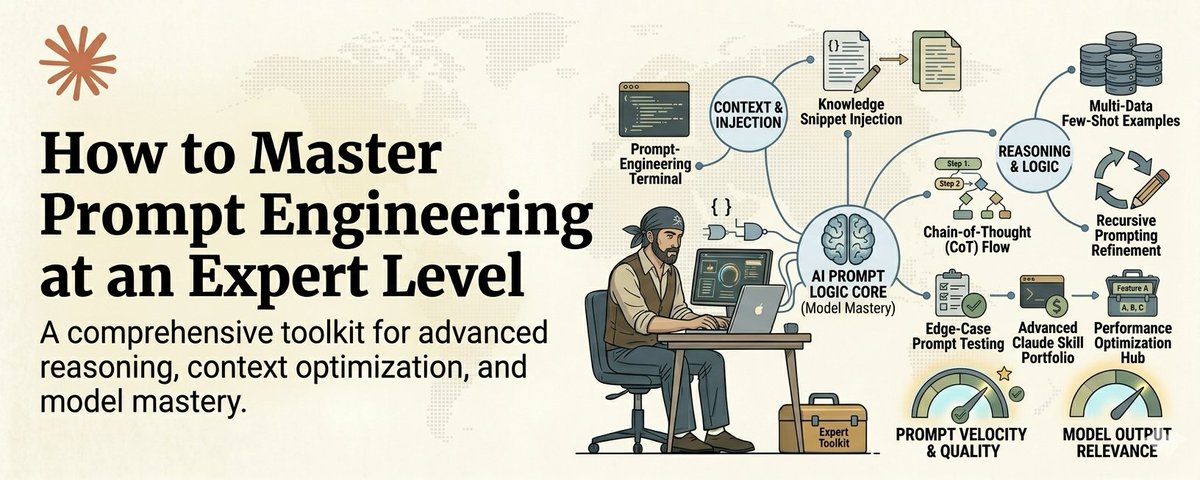

## 2026年のAIに関する耳の痛い真実

モデルがボトルネックなのではない。プロンプトがボトルネックなのだ。

2人の人間がまったく同じモデルでまったく同じタスクを行っても、品質において雲泥の差のある出力が得られることがある。一方は汎用的で表面的な回答が返ってきて、全部書き直す必要がある。もう一方は洗練されて精確ですぐに使える成果物が返ってくる。

違いはモデルではない。常にプロンプトにある。

プロンプトエンジニアリングはバズワードでも小手先のテクニックでもない。それはAIとのすべてのやり取りの品質上限を決定するがゆえに、今この瞬間のAI経済で最も価値あるスキルだ。

そしてほとんどの人はひどく下手だ。難しいからではない。誰もちゃんと教えてこなかったからだ。

この講座がそれを変える。初心者の概念から、世界のトップビルダーが毎日使うエキスパートレベルのテクニックまで。最後には、あなたのAIとのすべてのやり取りが劇的に良い結果を生み出すようになる。

---

## Level 1:基礎(ほとんどの人が間違えているところ)

上級テクニックに進む前に、なぜほとんどのプロンプトが失敗するかを理解する必要がある。

**なぜ悪いプロンプトが生まれるか:**

LLMは次のトークンを予測するよう訓練されている。プロンプトが曖昧だと、モデルは統計的に最も可能性の高いコンテンツ——つまり定義上、最も汎用的で平均的なコンテンツ——でギャップを埋める。

「AIについてブログ記事を書いて」は平均的なコンテンツを生む。なぜなら、モデルはAIについて今までに書かれたあらゆるものに似た、最も確率の高いブログ記事を生成するからだ。

「AIの導入に失敗する企業が多い理由について1,500語のブログ記事を書いて。対象読者は中堅SaaS企業のCTO。直接的でデータドリブンなトーン。対抗的な書き出し・ケーススタディの根拠を持つ3つの具体的な失敗パターン・具体的な90日間のアクションプランという構成で」と書くと、具体的なコンテンツが生まれる。モデルが何かユニークなものを生み出せるほど制約が与えられるからだ。

**根本原則:具体性が汎用性に勝つ。** プロンプトに加える詳細はひとつひとつ、モデルが平均にデフォルトする自由度を1つ取り除く。

---

## エキスパートのプロンプトを構成する6つの要素

エキスパートが書くすべてのプロンプトには、明示的または暗黙的に次の6要素が含まれている:

**要素1:Role(役割)**

この会話においてClaudeは誰なのか?「役に立つアシスタント」ではいけない。具体的なものにする。「B2B SaaSで15年の経験を持つシニアプロダクトストラテジスト」のように。役割はすべての返答の語彙・深さ・視点を形作る。

**要素2:Context(文脈)**

Claudeがあなたの状況について知っておくべきことは何か?業界・対象読者・制約・目標。文脈がなければ、Claudeはギャップを仮定で埋める。文脈があれば、関連情報でギャップを埋める。

**要素3:Task(タスク)**

Claudeが具体的に何をすべきか?「マーケティングを手伝って」ではなく、「価格・機能・メッセージングという観点で、特定の3社の競合と当社のポジショニングを比較する競合分析を書いて」のように。

**要素4:Format(フォーマット)**

出力はどんな形であるべきか?「3社すべてを比較する表と、その後に2段落の推奨事項」のように。フォーマットの指定がなければ、Claudeが推測する——その推測があなたの望むものと合うことはほとんどない。

**要素5:Constraints(制約)**

Claudeがしてはいけないことは何か?「マーケティング的な専門用語を使わない。あらゆる企業に当てはまる汎用アドバイスを含めない。500語を超えない」のように。ネガティブな制約は最もよくある失敗モードを切り落とす。

**要素6:Quality standard(品質基準)**

「十分に良い」とはどういう意味か?「この分析は、プロダクトチームがフォローアップの質問なしに5分以内に優先順位の意思決定ができるほど具体的であること」のように。

エキスパートのプロンプトは6要素すべてに触れる。初心者のプロンプトは通常1つか2つ。このギャップがエキスパートと初心者のAI出力品質の差のほぼすべてを説明する。

---

## Level 2:構造的なテクニック

プロンプトの作り方を変えるテクニックだ。

### XMLタグによる明確化

Claudeは構造化された入力で訓練されている。XMLタグはハックではなく——複数のコンポーネントを持つ複雑なプロンプトを処理するために設計された方法だ。

```xml

<context>

50名の従業員を抱え、建設会社向けのプロジェクト管理ソフトウェアを

販売するB2B SaaS企業を支援しています。

</context>

<task>

中堅建設会社のVP of Operationsへのコールドアウトリーチメールを書いてください。

</task>

<constraints>

- 150語以内

- 汎用的な書き出しなし(「このメールがあなたのもとに届くことを願っています」など)

- 建設プロジェクト管理の具体的なペインポイントに言及する

- 製品の影響について具体的で検証可能な主張を1つ含める

- コミットメントの低いCTA(「デモを予約する」ではなく)で締める

</constraints>

<output_format>

件名、その後にメール本文。それ以外は不要。

</output_format>

```

各タグはClaudeにそのセクションの役割を正確に伝える。contextは背景として処理される。taskは指示として処理される。constraintsは境界として処理される。タグが構造を明確にするため、モデルは各セクションを適切に扱う。

### Context First, Question Last(文脈が先、質問が後)

長いドキュメント・データ・参照資料がある場合は、常に質問の**上**に配置する:

```xml

<document>

[四半期財務データ500行]

</document>

上記の財務データに基づき、最も懸念される3つのトレンドを特定し、

なぜ各々がCFOの即時対応を必要とするかを説明してください。

```

モデルはまずドキュメントを処理し、理解を構築し、その後に完全な文脈が読み込まれた状態で質問に遭遇する。質問を先に書くと、遡及的な再解釈が強制され、測定可能なほど悪い結果になる。

### Few-Shot Examples(少数例)

1つの例は10段落の説明よりもClaudeに多くのことを教える。求めるパターンを見せよう:

```xml

<examples>

<example>

Input: "今四半期の解約率は5.2%から4.1%に下がった"

Output: "解約率4.1%(5.2%から)——21%の相対的改善。

現在のベースで維持するなら、年間約130名の追加顧客を維持することになる。

何が要因かを調査する価値あり:3月のオンボーディング変更か4月の料金改訂か?"

</example>

<example>

Input: "今四半期はエンジニアを12名採用した"

Output: "Q3に新エンジニア12名追加。通常3ヶ月のランプアップ期間を想定すると、

Q1に生産性の影響が出るはず。現エンジニア総数:47名。

計画会議で議論したチームとフィーチャーの比率が変わるか確認を。"

</example>

</examples>

これを分析してください:「マーケティング支出が34%増えたにもかかわらず、リード数は8%しか増えなかった"

```

通常ケースとエッジケースの両方をカバーする3〜5の多様な例が、どんな量の説明的な指示よりも良いアウトプットを生む。

---

## Level 3:上級テクニック

エキスパートが別のツールを使っているかのように見せるテクニックだ。

### Chain Method(連鎖法)

1つのプロンプトでClaudeに5つのことをさせてはいけない。連鎖させろ:

- Prompt 1:「建設プロジェクト管理分野の上位5社の競合を調べてください。」

- Prompt 2:「この競合分析を使って、どの競合も埋めていない3つの最大のポジショニングのギャップを特定してください。」

- Prompt 3:「これらのギャップに基づいて、そのうちの1つを明示的に主張する製品のポジショニングステートメントを書いてください。」

- Prompt 4:「このポジショニングに基づいて、ホームページのヘッドライン・サブヘッドライン・3つのサポートポイントを書いてください。」

各プロンプトが集中している。各アウトプットが深い。品質がすべての段階で複利的に向上する。そして各段階でレビューと修正ができる——一体型の巨大プロンプトでは不可能だ。

### Self-Correction Loop(自己修正ループ)

Claudeからの最初の返答はすべてドラフトだ。改訂させよう:

```

自分の返答を読み直してください。正確性・具体性・実行可能性について1〜10で評価してください。

8未満のすべての次元について、何が弱いかを説明して修正してください。

改善版のみを表示してください。

```

修正版は85〜90%の確率でより良い。これを追加するのに15秒かかり、測定可能なほど良いアウトプットが生まれる。重要なタスクすべてに使え。

### Motivated Constraint(理由付きの制約)

制約が何かだけでなく、**なぜ**その制約が存在するかをClaudeに伝える:

- 悪い:「200語以内に収めて。」

- 良い:「200語以内に収めて——これはTelegramの投稿に入るもので、それより長いとプラットフォームに切られてしまう。」

- 悪い:「専門用語を避けて。」

- 良い:「専門用語を避けて——読者は技術に詳しくないビジネスオーナーで、理解できない言葉に出会うと離脱する。」

Claudeが制約の背景にある理由を理解すると、制約をより賢く適用し、単純なルールでは見逃すエッジケースを捉えられる。

### Multi-Perspective Analysis(多視点分析)

深みを必要とする意思決定に:

```

この価格設定の意思決定を3つの視点から分析してください:

1. 市場シェアの最大化を目指す成長重視のCEO

2. マージンとランウェイを見ているCFO

3. 公正な価格で公正な価値を望む顧客

各視点:3文でそれぞれの立場を論じる。

次に3つすべてのバランスを取る推奨事項にまとめる。

どの視点を最も重視したか、その理由をフラグ付きで示す。

```

これはClaudeに1つの次元を最適化するのではなくトレードオフを検討させる。単一視点のプロンプトより劇的に良い戦略分析が生まれる。

### The Meta-Prompt(メタプロンプト)

良いプロンプトを書くのに苦労しているときは、Claudeに書かせよう:

```

達成したいこと:[目標を説明する]

Context:[背景情報]

良いアウトプットとはどんなものか:[説明または例]

この結果を達成するための最も効果的なプロンプトを書いてください。

不足しているContextを加え、曖昧さを取り除き、最高品質のアウトプットのために構造化してください。

```

Claudeは何が良いアウトプットを生むかを知っている。メタプロンプトテクニックはその知識を使って、提出前にリクエストを改善する。生成されたプロンプトは自分で書くものよりほぼ常に優れている——自分では気づかなかった盲点を捉えるからだ。

---

## Level 4:システムレベルのマスタリー

個別のプロンプトはタクティクスだ。システムがストラテジーだ。

### Context Files(コンテキストファイル)

自分が行うすべての種類の仕事に対して、永続的なMarkdownファイルを作成する:

- `writing-rules.md` — 自分の声・対象読者・基準。

- `analysis-framework.md` — データの評価方法・重要なメトリクス。

- `project-context.md` — 現在のプロジェクト・ステータス・重要な意思決定。

各セッションの開始時:「始める前に [ファイル] を完全に読んでください。すべてのルールに従ってください。ルールを破ろうとしている場合は止まって教えてください。」

Claudeは会話全体にわたってファイルのルールを適用する。好みを再説明する必要がなくなる。アウトプット品質に基づいてファイルを更新するほど、ファイルは賢くなる。

### Template Libraries(テンプレートライブラリ)

書いた優れたプロンプトはすべて再利用可能なテンプレートとして保存すべきだ。具体的な内容をはぎ取り、変数に置き換え、構造を保持する。

月を経るにつれて、すべてのタスクタイプのテンプレートライブラリが構築される——コンテンツ制作・分析・コードレビュー・戦略立案・メール執筆。ゼロから始めることがなくなる。テンプレートを取り出し、変数を入れ、一貫して優れたアウトプットを得る。

この複利効果が本物のエキスパートのアドバンテージだ。優れた結果のひとつひとつが、次の結果の土台となる。

### Weekly Feedback Loop(週次フィードバックループ)

毎週金曜日:その週のAIアウトプットを振り返る。目標を外したものは?どんなプロンプトの変更が修正できたか?コンテキストファイルに追加すべき新しいルールは何か?

これを3ヶ月間毎週行った人は、始めた頃と比べて認識できないほどのプロンプト能力を持っている。しない人は永遠に同じレベルにとどまる。

---

## まとめ

プロンプトエンジニアリングは魔法の一文を見つけることではない。AIとのすべてのやり取りの具体性・構造・コンテキストを体系的に高めることだ。

**すべてのプロンプトに6要素。構造のためにXMLタグ。形容詞より例。一体型より連鎖。すべての重要なタスクに自己修正。永続的な記憶のためのコンテキストファイル。品質を複利化するテンプレート。**

これらのテクニックを学べ。毎日練習せよ。毎週磨け。

あなたのアウトプット品質と他の全員のアウトプット品質の差は、毎月広がっていく。

ほとんどの人は曖昧なプロンプトを入力し続け、平凡な結果を受け入れ続ける。

プロンプトをマスターした人々は、まるで完全に別のテクノロジーのような結果を得る。

プロンプトエンジニアリングAIスキルエキスパート技術claude-workflow

プロンプトエンジニアリング完全マスター講座:初心者からエキスパートへの全技術体系

♥ 523↻ 77

原文を表示 / Show original

Khairallah AL-Awady

@eng_khairallah1

How to Master Prompt Engineering at an Expert Level (Full Course)

52

103

602

1.6M

Here is an uncomfortable truth about AI in 2026.

Save this :)

The model is not the bottleneck. The prompt is.

Two people can use the exact same model, on the exact same task, and get outputs that are miles apart in quality. One gets a generic, surface-level response they have to rewrite entirely. The other gets a polished, precise, production-ready result they can use immediately.

The difference is never the model. It is always the prompt.

Prompt engineering is not a buzzword. It is not a trick. It is the single most valuable skill in the AI economy right now because it determines the quality ceiling of every AI interaction you have.

And most people are terrible at it. Not because it is hard. Because nobody taught them properly.

This course changes that. From beginner concepts to expert-level techniques that the top builders in the world use daily. By the end, every AI interaction you have will produce dramatically better results.

Level 1: The Foundation (What Most People Get Wrong)

Before we get to advanced techniques, you need to understand why most prompts fail.

Why bad prompts happen:

LLMs are trained to predict the most likely next token. When your prompt is vague, the model fills gaps with the most statistically probable content - which is, by definition, the most generic and average content.

"Write a blog post about AI" produces average content because the model generates the most probable blog post about AI - the one that sounds like everything else ever written about AI.

"Write a 1,500-word blog post about why most businesses fail at AI adoption, targeted at CTOs of mid-market SaaS companies, in a direct and data-driven tone, structured with a contrarian opening, three specific failure patterns with case study evidence, and a concrete 90-day action plan" produces specific content because the model has enough constraints to produce something unique.

The fundamental principle: specificity defeats generality. Every detail you add to a prompt removes a degree of freedom where the model would otherwise default to average.

The 6 Elements of Every Expert Prompt

Every prompt an expert writes contains these six elements, whether explicitly or implicitly:

Element 1: Role. Who is Claude in this conversation? Not "a helpful assistant." Something specific. "A senior product strategist with 15 years of B2B SaaS experience." The role shapes the vocabulary, the depth, and the perspective of every response.

Element 2: Context. What does Claude need to know about your situation? Your industry, your audience, your constraints, your goals. Without context, Claude fills gaps with assumptions. With context, it fills gaps with relevant information.

Element 3: Task. What specifically should Claude do? Not "help me with marketing." Something like "write a competitive analysis comparing our positioning against three specific competitors across pricing, features, and messaging."

Element 4: Format. What should the output look like? "A table comparing all three competitors, followed by a 2-paragraph recommendation." Without format specifications, Claude guesses - and its guess rarely matches what you wanted.

Element 5: Constraints. What should Claude NOT do? "Do not use marketing jargon. Do not include generic advice that applies to every company. Do not exceed 500 words." Negative constraints cut off the most common failure modes.

Element 6: Quality standard. What does "good enough" mean? "The analysis should be specific enough that our product team can make a prioritization decision in under 5 minutes without asking follow-up questions."

An expert prompt hits all six elements. A beginner prompt typically hits one or two. That gap explains almost every quality difference between expert and beginner AI outputs.

Level 2: Structural Techniques

These are the techniques that change how you build prompts.

XML Tags for Clarity

Claude was trained on structured inputs. XML tags are not a hack - they are how the model is designed to process complex prompts with multiple components.

xml

<context>

You are helping a B2B SaaS company with 50 employees

that sells project management software to construction firms.

</context>

<task>

Write a cold outreach email to a VP of Operations at a

mid-size construction company.

</task>

<constraints>

- Under 150 words

- No generic opening lines ("I hope this email finds you well")

- Reference a specific pain point in construction project management

- Include one specific, verifiable claim about our product's impact

- End with a low-commitment CTA (not "book a demo")

</constraints>

<output_format>

Subject line, then email body. Nothing else.

</output_format>

Each tag tells Claude exactly what role that section plays. Context is processed as background. Task is processed as the instruction. Constraints are processed as boundaries. The model treats each section appropriately because the tags make the structure unambiguous.

Context First, Question Last

When you have long documents, data, or reference material, always place it ABOVE your question:

xml

<document>

[500 lines of quarterly financial data]

</document>

Based on the financial data above, identify the 3 most

concerning trends and explain why each one requires

immediate attention from the CFO.

The model processes the document first, builds understanding, then encounters the question with full context loaded. Placing the question first forces retroactive reinterpretation, which produces measurably worse results.

Few-Shot Examples

One example teaches Claude more than ten paragraphs of description. Show the pattern you want:

xml

<examples>

<example>

Input: "Our churn rate dropped from 5.2% to 4.1% this quarter"

Output: "Churn down to 4.1% from 5.2% — a 21% relative

improvement. If this holds, we retain roughly 130 additional

customers annually at our current base. Worth investigating

what drove it: was it the onboarding changes from March or

the pricing restructure in April?"

</example>

<example>

Input: "We hired 12 engineers this quarter"

Output: "12 new engineers added in Q3. Assuming our standard

ramp time of 3 months, we should see productivity impact in

Q1 next year. Current engineering headcount: 47. Check if

this changes the team-to-feature ratio we discussed in the

planning meeting."

</example>

</examples>

Now analyze this: "Marketing spend increased 34% while

lead volume grew only 8%"

Three to five diverse examples - covering normal cases AND edge cases - produce better output than any amount of descriptive instruction.

Level 3: Advanced Techniques

These are the techniques that make experts look like they are using a different tool.

The Chain Method

Never ask Claude to do five things in one prompt. Chain them:

Prompt 1: "Research the top 5 competitors in the construction project management space."

Prompt 2: "Using this competitive analysis, identify the 3 biggest positioning gaps that no competitor is filling."

Prompt 3: "Based on these gaps, write a positioning statement for our product that claims one of these gaps explicitly."

Prompt 4: "Now write the homepage headline, subheadline, and three supporting points based on this positioning."

Each prompt is focused. Each output is deep. Quality compounds at every step. And you can review and correct at each stage - impossible with a single monolithic prompt.

The Self-Correction Loop

Every first response from Claude is a draft. Make it revise:

Reread your response. Rate it 1-10 on accuracy, specificity,

and actionability. For any dimension below 8, explain what is

weak and fix it. Show only the improved version.

The revised version is better 85 to 90 percent of the time. This takes 15 seconds to add and produces measurably better output. Use it on every important task.

The Motivated Constraint

Tell Claude WHY a constraint exists, not just what it is:

Bad: "Keep it under 200 words." Good: "Keep it under 200 words - this goes into a Telegram post where anything longer gets cut off by the platform."

Bad: "Avoid jargon." Good: "Avoid jargon - the reader is a non-technical business owner who will disengage if they encounter terms they do not understand."

When Claude understands the reason behind a constraint, it applies the constraint more intelligently and catches edge cases the bare rule would miss.

The Multi-Perspective Analysis

For decisions that require depth:

Analyze this pricing decision from three perspectives:

1. The growth-focused CEO who wants to maximize market capture

2. The CFO watching margins and runway

3. The customer who just wants fair value for fair price

Each perspective: 3 sentences arguing their case.

Then synthesize into a recommendation that balances all three.

Flag which perspective you weighted most and why.

This forces Claude to consider tradeoffs instead of optimizing for one dimension. Produces dramatically better strategic analysis than single-perspective prompts.

The Meta-Prompt

When struggling to write a good prompt, let Claude write it:

I want to accomplish: [describe your goal]

Context: [background information]

What good output looks like: [description or example]

Write me the most effective prompt to achieve this result.

Add missing context, remove ambiguity, and structure it

for the highest quality output.

Claude knows what produces good outputs. The meta-prompt technique uses this knowledge to improve your request before you submit it. The generated prompt is almost always better than what you would write yourself because it catches blindspots you did not notice.

Level 4: System-Level Mastery

Individual prompts are tactics. Systems are strategy.

Context Files

Create persistent markdown files for every type of work you do:

writing-rules.md - Your voice, your audience, your standards. analysis-framework.md - How you evaluate data, what metrics matter. project-context.md - Current projects, status, key decisions.

At the start of each session: "Read [file] fully before starting. Follow every rule. If you are about to break a rule, stop and tell me."

Claude applies the file's rules across the entire conversation. You never re-explain your preferences. The files get smarter as you update them based on output quality.

Template Libraries

Every great prompt you write should be saved as a reusable template. Strip the specifics, replace with variables, keep the structure.

Over months, you build a library of templates for every task type. Content creation, analysis, code review, strategy, email writing. You never start from scratch. You pull the template, fill the variables, and get consistently excellent output.

This compounding effect is the real expert advantage. Each great result becomes the foundation for the next one.

The Weekly Feedback Loop

Every Friday: review your AI outputs from the week. What missed the mark? What prompt change would have fixed it? What new rule should you add to your context files?

The people who do this weekly for three months have a prompting ability that is unrecognizable compared to where they started. The people who do not stay at the same level permanently.

The Bottom Line

Prompt engineering is not about finding the one magical phrase. It is about systematically increasing the specificity, structure, and context of every interaction you have with AI.

Six elements in every prompt. XML tags for structure. Examples over adjectives. Chains over monoliths. Self-correction on every important task. Context files for persistent memory. Templates for compounding quality.

Learn these techniques. Practice them daily. Refine them weekly.

The gap between your output quality and everyone else's will grow wider every single month.

Most people will keep typing vague prompts and accepting mediocre results.

The ones who master prompting will get results that feel like a completely different technology.

Follow me @eng_khairallah1 for more prompt engineering techniques, frameworks, and expert-level breakdowns.

hope this was useful for you, Khairallah ❤️

Want to publish your own Article?

Upgrade to Premium

6:18 PM · Apr 22, 2026

·

1.6M

Views

52

103

602

2K

Read 52 replies