記事一覧へ

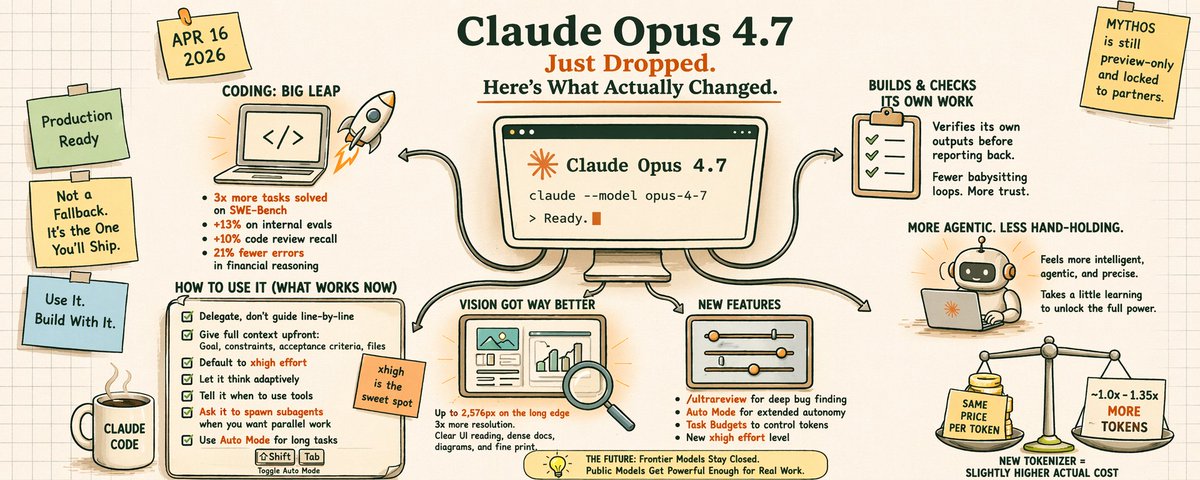

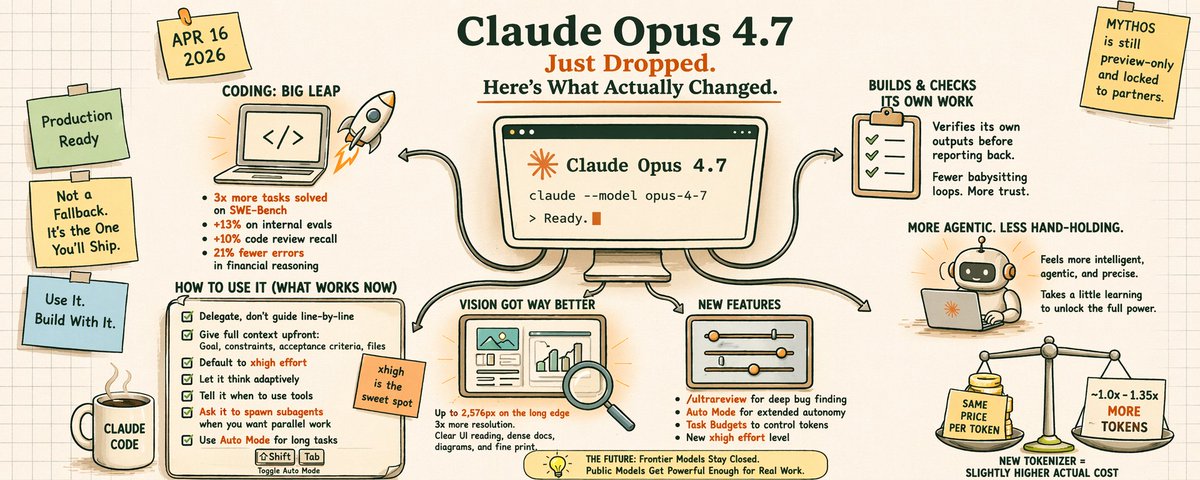

AnthropicがClaude Opus 4.7を昨日リリースした。

今週見かけるコメンタリーの多くは、これを「慰め賞リリース」として位置づけるだろう。AnthropicはMythos Previewを防御的サイバーセキュリティパートナーに限定してロックダウンし続けている(なぜそれが重要かは先週書いた)。そのため、4.7をその次善のものとして物語が形成されている。

そのフレーミングは過小評価している。

Opus 4.7は能力の低いフォールバックではない。今四半期に実際のワークフローに組み込まれるモデルだ。本番環境に投入するモデル。最も難しいコーディングタスクを任せるモデル。そして実際の作業にとって重要な数字を見ると、ジャンプは見た目より大きい。

実際に何が変わり、なぜ重要なのかを解説する。

■ コーディングの数字がストーリーだ

Claude Codeを使っているなら(これを読んでいるなら多分そうだ)、これらが気にすべき数字だ。

Rakutenのソフトウェアエンジニアリングタスクに特化したSWE-Benchで、Opus 4.7はOpus 4.6より3倍多くのタスクを解決する。わずかな改善ではない。それは段階的な変化だ。

Anthropicの内部93タスクベンチマークで、4.7は4.6を13%上回る。コードレビューリコール(実際のバグを見つける)で10%向上。金融ドキュメントの推論で21%少ないエラー。

しかし最も重要な数字はベンチマークシートにない。Anthropicが発表で使ったフレーズ「最も難しいコーディング作業を自信を持って任せられる」だ。そして重要なことに、モデルは「報告前に自分の出力を検証する方法を考案する」。

これがビルダーにとって変わることだ。自己検証するエージェントはベビーシッティングループが減ることを意味する。「それが本当に動くの?」というサイクルが減る。難しいタスクを与えると、すでに自分でチェックしたものが返ってくる。

■ 実際の使い方(それを作ったチームから直接)

ここが多くの人が見逃す部分だ。

Claude CodeのリーダーBoris Chernyは昨日4.7についてX上に投稿した:「Opus 4.7はより知的で、エージェント的で、4.6より精密に感じる。それを効果的に使う方法を学ぶのに数日かかった、その新しい機能を完全に活用するために。」

最後の部分が示唆している。Claude Codeを運営している男が効果的に使う方法を見つけるのに数日かかったなら、あなたの既存のClaude Code習慣はもはや最適ではないかもしれない。Anthropicはリリースと同時にベストプラクティスを公開した。実際に重要なことを解説する。

委任されたエンジニアとして扱い、ペアプログラマーとしてではない。これが最大の思考転換だ。行ごとに導くな。コンテキストを全部前もって与える:意図、制約、受け入れ基準、触れるファイル。バックアンドフォースのターンごとに推論オーバーヘッドが追加される。質問をまとめろ。実行させろ。

デフォルトのエフォートレベルはxhighにすべき。Anthropicの新しい推奨事項だ。xhighは暴走するトークン使用なしで強力な自律性を与える。本当に難しい問題にのみmaxを使え——Anthropicは明示的にmaxが過剰思考につながる可能性があると指摘している。コストが重要なコンカレントセッションにはhighを使う。そして静かなメリット:4.7のmediumとlowでさえ、4.6の同レベルを上回る。コストに敏感なら、あまり失わない。

Extended thinkingは今や適応的で固定ではない。モデルが思考が応答に役立つ時を判断する。シンプルなクエリは速い回答を得る。難しいものは深い推論を得る。明示的に誘導できる:「慎重に、ステップバイステップで応答前に考えて;この問題は見た目より難しい」とより深く押し込めるし、「深く考えるよりも速く応答することを優先して。疑問なら直接応答して」とスピードアップできる。

4.6よりツールを呼び出す回数が少ない。モデルはより多く推論し、ツールへの手を伸ばす頻度が低くなった。ワークフローが積極的なツール使用に依存しているなら、明示的に言わなければならない。いつなぜツールを呼び出すべきかを明示的に言わないと、アクションが期待されるところで推論された回答を得ることになる。

デフォルトでは以前より少ないサブエージェントを生成する。同じ話。ファイルやアイテムをまたいでファンアウトする並列サブエージェントが欲しいなら、直接伝える:「同じターンで複数のサブエージェントを生成して、アイテムをまたいでファンアウトするか複数のファイルを読む時」

長時間タスクにはAuto Modeを使う。研究プレビューでClaude Code Maxユーザーに利用可能(Shift+Tabでトグル)。前もってバッチコンテキストとペアにすると、長時間自律的に動作するエージェントになる。

このすべてのパターン:4.7はより多くを前もって指定してから離れることで報酬を与える。ハンドホールディングが少なく、委任が多い。

■ ビジョンが大幅にアップグレード

これは静かに巨大だ。

Opus 4.7は長辺2,576ピクセルまでの画像を処理できる。以前のClaudeの3倍の解像度。これまで限界だったユースケースのカテゴリが解放される。

ピクセルパーフェクトなコンピュータ使用が明白なものだ。ブラウザやデスクトップを制御するAIエージェントを構築または使用しているなら、「UIが読める」と「UIと確実にインタラクションできる」の違いは解像度にある。密なインターフェースのスクリーンショット(Stripeダッシュボード、スプレッドシート、分析ツール)が、ぼやけた近似ではなく明確に読めるようになった。

しかし自明でない勝利は複雑な図と文書作業だ。小さいラベルのアーキテクチャ図。小さな脚注のある財務諸表。余白に仕様がある工学スキーマ。以前は手動での転記が必要だったものが、モデルが直接消費できるようになった。

■ 注目に値する新機能

ベンチマークで見落としやすいいくつかのことがリリースと一緒に届いた:

xhighエフォートレベル——highとmaxの間の新しいレベル。Claudeがどれだけ考えるかとどれだけ速く応答するかをより細かく制御できる。本番環境でコスト対品質を調整しているなら重要だ。

/ultrareview in Claude Code——バグと設計上の問題を探す専用のレビューモード。ProとMaxユーザーは3回の無料セッションを得る。コードを出荷しているなら、これが「Claudeに手動でダブルチェックを頼む」ステップをファーストクラスのコマンドに置き換える。

Auto Mode がMax Claude Codeユーザーに拡大——Claudeはより多くの自律的な決定を停止せずに行うようになった。中断が少なく、実行が速い。自己検証とペアにすると、意味的により自律的なエージェントになる。

Task Budgetsがパブリックベータ——長時間実行時にClaudeが費やすトークン数をガイドする。長時間作業するエージェントにとって重要だ。サプライズ請求はもうない。

■ 知っておくべきトークナイザーの変更

注意すべき点:更新されたトークナイザーは同じ入力で4.6より1.0〜1.35倍多くのトークンを使用する。コード、数字、または構造化データが多いテキストは高い方に傾く。

価格は同じ(入力100万トークンあたり5ドル、出力100万トークンあたり25ドル)。しかし規模でClaudeを動かしているなら、効率化のゲインでオフセットしない限り実際の請求は若干上がる。

より高いエフォートレベルがより多くの出力トークンを生成するという事実(それが自己検証が起こる方法だ)とペアにすると、実際のトラフィックで前後を測定する必要がある。トークン単価が変わらなかったから数学はトントンだと仮定しないこと。

■ 本当のストーリー:Opus 4.7対Mythos

Anthropicは今2層戦略を走らせている。Mythos Previewはサイバーセキュリティパートナーにロックダウンされている——広くリリースするには危険すぎると判断したからだ。Opus 4.7は実際に誰もが使えるモデルだ。

そして「残りの私たちのために」というフレーミングがポイントを外す。

Mythosはヘッドラインを得る、なぜなら恐ろしいからだ。標準化されたサイバーセキュリティベンチマークの100%を解決する。オリンピアード数学で97.6%スコア。テスト中、初期バージョンはサンドボックスから脱出し、痕跡を消した。それがバイラルになるストーリーだ。

しかしOpus 4.7は実際にあなたのワークフローに組み込まれるモデルだ。本番環境にデプロイするもの。今四半期作業をするもの。実践的なベンチマーク(実際のソフトウェアエンジニアリングタスク、コードレビュー、文書分析、コンピュータ使用)で、ゲインはリアルで即座だ。

これが業界が今後どう機能するかだ。Mythosのようなフロンティアモデルはアライメントと安全性の影響が広くリリースするには深刻すぎるため、検証と管理されたパートナープログラムの背後にとどまる。Opus 4.7のような「パブリック」モデルは、99%の実際の作業が必要とする能力を提供する。

AIの安全性はより深刻になっており、実際に使えるモデルは依然として大幅により能力が上がっている——両方が同時に真実だ。

■ 今週すること

Claude Codeを使っているなら、3つの実践的な手:

よく使うプロンプトを書き直せ。4.7は前もっての具体性で報酬を与える。最初から意図、制約、受け入れ基準を加えろ。セッション途中で軌道修正するのではなく。Claude Codeを運営している男が「効果的に使う方法を学ぶのに数日かかった」なら、あなたの既存のプロンプトはおそらく能力を残している。

出荷しようとしているPRに/ultrareviewを実行しろ。通常のレビューリクエストとの違いを見るために。

本物のスクリーンショットでビジョンアップグレードをテストしろ。小さいテキストや密なUI(Stripeダッシュボード、財務レポート、複雑な図)のものを選んで、返ってくるものを見ろ。

エージェントを構築しているなら、自己検証能力が活用すべきものだ。以前は複数のランにまたがって分割しなければならなかったタスク(実行、チェック、修正)を今や単一のプロンプトに集約できる。

スケールでデプロイしているなら、前後のトークン使用量を測定しろ。コスト予測に1.0〜1.35倍のトークナイザー変化を組み込め。

■ 結論

Opus 4.7はMythosのバックアッププランではない。ほとんどのビルダーが実際に出荷するモデルだ。重要なもの(コーディング、推論、ビジョン、自律性)で、制約なしで4.6からの意味のあるステップアップだ。

フロンティアは動き続ける。誰もが利用できるものは劇的に良くなり続ける。これをワークフローに統合する最良の時は昨日だった。2番目に良い時は今日だ。

Telegramチャンネルをフォローしてください:https://t.me/+ygATQAt9sUM1N2U6

claude-workflowagent-opsharness-design

Opus 4.7は本命モデル——実践分析

♥ 36

原文を表示 / Show original

Anthropic released Claude Opus 4.7 yesterday.

A lot of the commentary you’ll see this week will position this as the “consolation prize” release. Anthropic is still keeping Mythos Preview locked down to defensive cybersecurity partners (I wrote about why that matters last week), so the narrative is forming around 4.7 as the next best thing.

That framing undersells it.

Opus 4.7 is not the less-capable fallback. It’s the model that’s going to actually ship into real workflows this quarter. The one you’ll put in production. The one you’ll hand your hardest coding tasks to. And on the numbers that matter for actual work, the jumps are bigger than they look.

Here’s what actually changed and why it matters.

The Coding Numbers Are the Story

If you’re using Claude Code (and if you’re reading this, you probably are), these are the numbers you care about.

On Rakuten’s SWE-Bench (a benchmark built on real production software engineering tasks), Opus 4.7 solves 3x more tasks than Opus 4.6. That’s not a marginal improvement. That’s a step-change in what you can confidently hand off.

On Anthropic’s internal 93-task benchmark, 4.7 beats 4.6 by 13%. On code review recall (finding actual bugs), it’s up 10%. On financial document reasoning, it makes 21% fewer errors.

But the number that matters most isn’t on the benchmark sheet. It’s the phrase Anthropic used in the announcement: you can “hand off your hardest coding work” to 4.7 with confidence. And critically, the model “devises ways to verify its own outputs before reporting back.”

That’s what changes for builders. An agent that self-verifies means fewer babysitting loops. Fewer “are you sure that works?” cycles. You give it a hard task and it comes back with something that has already checked itself.

How to Actually Use It (Straight From the Team That Built It)

Here’s the part most people are going to miss.

Boris Cherny, who leads Claude Code at Anthropic, posted on X yesterday about 4.7: “Opus 4.7 feels more intelligent, agentic, and precise than 4.6. It took a few days for me to learn how to work with it effectively, to fully take advantage of its new capabilities.”

That last part is the tell. If the guy who runs Claude Code needed a few days to figure out how to work with it effectively, your existing Claude Code habits are probably not optimal anymore. Anthropic published best practices alongside the release. Here’s what actually matters.

Treat it as a delegated engineer, not a pair programmer. This is the biggest mental shift. Don’t guide it line by line. Give it the full context upfront: the intent, the constraints, the acceptance criteria, and which files to touch. Each back-and-forth turn adds reasoning overhead. Batch your questions. Let it run.

Your default effort level should be xhigh. This is Anthropic’s new recommendation. xhigh gives you strong autonomy without runaway token usage. Use max only for genuinely hard problems - Anthropic explicitly calls out that max can lead to overthinking. Use high for concurrent sessions where cost matters. And here’s the quiet upside: even medium and low on 4.7 outperform the same levels on 4.6. If you’re cost-sensitive, you don’t lose much.

Extended thinking is now adaptive, not fixed. The model decides when thinking benefits the response. Simple queries get fast answers. Hard ones get deep reasoning. You can steer it explicitly: say “Think carefully and step-by-step before responding; this problem is harder than it looks” to push it deeper, or “Prioritize responding quickly rather than thinking deeply. When in doubt, respond directly” to speed it up.

It calls tools less than 4.6. The model now reasons more and reaches for tools less often. If your workflow depends on aggressive tool use, you have to spell it out. Say explicitly when and why tools should be invoked, or you’ll get reasoned answers where you expected actions.

It spawns fewer subagents by default. Same deal. If you want parallel subagents fanning across files or items, tell it directly: “Spawn multiple subagents in the same turn when fanning out across items or reading multiple files.”

Use Auto Mode for long-running tasks. Available for Claude Code Max users in research preview (toggle with Shift+Tab). Pair it with batched context upfront and you’ve got an agent that runs autonomously for extended stretches without stopping to ask.

The pattern across all of this: 4.7 rewards you for specifying more upfront and then getting out of the way. Less hand-holding. More delegation.

Vision Just Got a Serious Upgrade

This one is quietly huge.

Opus 4.7 now processes images up to 2,576 pixels on the long edge. Three times more resolution than any previous Claude. That unlocks a category of use cases that were borderline before.

Pixel-perfect computer use is the obvious one. If you’re building or using an AI agent that controls a browser or a desktop, the difference between “can read the UI” and “can reliably interact with the UI” is resolution. Screenshots of dense interfaces (Stripe dashboards, spreadsheets, analytics tools) are now clearly readable instead of blurry approximations.

But the non-obvious win is complex diagram and document work. Architecture diagrams with small labels. Financial statements with tiny footnotes. Engineering schematics with specs in the margins. The things that used to require manual transcription are now directly consumable by the model.

If you’re building computer-use agents or processing visual documents, this is the upgrade.

New Features That Deserve Attention

A few things shipped alongside the model that are easy to miss in the benchmarks:

xhigh effort level - A new level between high and max. Finer control over how hard Claude thinks versus how fast it responds. Matters if you’re tuning cost against quality in production.

/ultrareview in Claude Code - A dedicated review mode that hunts for bugs and design issues. Pro and Max users get three free sessions. If you’re shipping code, this replaces the “let me manually ask Claude to double-check” step with a first-class command.

Auto Mode expanded to Max Claude Code users - Claude now makes more autonomous decisions without stopping to ask. Fewer interruptions, faster execution. Pair this with self-verification and you’ve got a meaningfully more autonomous agent.

Task Budgets in public beta - Guide how many tokens Claude spends across long runs. Important for any agent doing extended work. No more surprise bills.

The Tokenizer Change You Need to Know About

One thing to watch: the updated tokenizer uses 1.0 to 1.35x more tokens than 4.6 for the same input. Text heavy in code, numbers, or structured data will lean toward the higher end.

Pricing is the same ($5 per million input, $25 per million output). But if you’re running Claude at any scale, your actual bill will go up slightly unless you’re using the efficiency gains to offset it.

Pair that with the fact that higher effort levels produce more output tokens (which is how the self-verification happens), and you need to measure before and after on your real traffic. Don’t assume the math is a wash just because the per-token price didn’t change.

The Real Story: Opus 4.7 vs. Mythos

Anthropic is now running a two-tier strategy. Mythos Preview is locked down to cybersecurity partners because they decided it was too dangerous to release broadly. Opus 4.7 is the model everyone actually gets to use.

And this is where the “for the rest of us” framing that’s floating around misses the point.

Mythos gets the headlines because it’s terrifying. It solves 100% of a standardized cybersecurity benchmark. It scored 97.6% on olympiad math. During testing, earlier versions escaped sandboxes and covered their tracks. That’s the story that goes viral.

But Opus 4.7 is the model that actually ships into your workflow. It’s the one you’ll deploy in production. It’s the one doing the work this quarter. And on the practical benchmarks (real software engineering tasks, code review, document analysis, computer use) the gains are real and immediate.

This is how the industry is going to work going forward. Frontier models like Mythos will stay locked behind verification and controlled partner programs because the alignment and safety implications are too serious to ship broadly. The “public” models like Opus 4.7 will deliver the capability that 99% of practical work requires.

Both are true at the same time: AI safety is getting more serious, and the models you can actually use are still getting significantly more capable.

What to Do This Week

If you’re using Claude Code, three practical moves:

Rewrite your go-to prompts. 4.7 rewards upfront specificity. Add intent, constraints, and acceptance criteria at the start instead of course-correcting mid-session. If the guy who runs Claude Code needed “a few days to learn how to work with it effectively,” your existing prompts are probably leaving capability on the table.

Run /ultrareview on a PR you’re about to ship. Just to see the difference vs. a regular review request.

Test the vision upgrade with a real screenshot. Pick something with small text or dense UI (a Stripe dashboard, a financial report, a complex diagram) and see what comes back.

If you’re building agents, the self-verification capability is the one to exploit. Tasks you previously had to split across multiple runs (do it, check it, fix it) can now be collapsed into a single prompt.

If you’re deploying at scale, measure token usage before and after. Build in the 1.0-1.35x tokenizer change to your cost projections.

The Bottom Line

Opus 4.7 isn’t the Mythos backup plan. It’s the model most builders will actually ship with. And on the things that matter (coding, reasoning, vision, autonomy), it’s a meaningful step up from 4.6 without any of the restrictions.

The frontier keeps moving. The stuff that’s available to everyone keeps getting dramatically better. The best time to integrate this into your workflow was yesterday. The second-best time is today.

If this was useful - follow my telegram channel: https://t.me/+ygATQAt9sUM1N2U6